ローカルLLMでもここまでできる!最新AIの実力を試してみたら意外な結末に…?

最近のAI業界はまさにジェットコースターのように進化が加速しています。特に、LLM(大規模言語モデル)の進化が止まりません!数年前までは「AIが自然な文章を生成するなんて無理でしょ?」と思われていたのが、今では当たり前の技術になっています。

本記事では、LLMの歴史や最新モデルの比較、ローカルLLMの可能性、そして意外な活用法までをまとめました。最後まで読めば、今のLLMがどこまで進化しているのか、しっかり理解できるはずです!

LLMって何?

まずは「そもそもLLMとは?」という基本から。LLM(Large Language Model)は、大量のテキストデータを学習し、自然な言語を理解・生成できるAIのことです。

LLMの歴史ざっくりまとめ

- 2018年:GPT-1(OpenAI)登場。まだシンプルなモデルだった。

- 2019年:GPT-2が「文章を勝手に生成しすぎる」と話題に。

- 2020年:GPT-3登場。1750億パラメータで一気に実用レベルに。

- 2023年〜現在:GPT-4、Claude、Geminiなど、より高性能なモデルが次々登場。

現在のLLMは「テキストの生成」だけでなく、画像解析やコード生成、論理的な推論までできるレベルに達しています。

最新LLMの比較表

| モデル名 | 開発元 | パラメータ数 | 特徴 |

| GPT-4 | OpenAI | 非公開 (1兆以上?) |

マルチモーダル対応 |

| Claude 3 | Anthropic | 非公開 | 長文の理解が 得意 |

| Gemini 1.5 | Google DeepMind | 非公開 | マルチモーダル対応+長文対応 |

| Mistral 7B | Mistral AI | 70億 | 軽量で高速 |

| LLaMA 3 | Meta | 未発表 | ローカル環境 向け |

現在のトレンドとして、「RAG(Retrieval-Augmented Generation)」が注目されています。これは、AIが事前学習した知識だけでなく、外部のデータベースから情報を取得して、より正確な回答を生成する技術。要するに、「LLMが知識をリアルタイムで学習できる時代」が既に来ています。

PCにローカルLLM環境を構築してみた!

クラウドのLLMもすごいですが、最近はローカルで動かせるLLMも進化しています。そこで、実際に自前のPCで動かしてみたので、そのレポートをお届けします。

今回、お試しするローカルLLMは、Metaが開発した Llama のローカル版 Ollama を使用します。

https://github.com/ollama/ollama

Ollamaのインストールが終わったら、モデルファイルを指定してAIサーバーを起動します。

ダウンロードされていないモデルは、初回起動時にダウンロードされます。

ollama run llama3.1

>>> Send a message (/? for help)

ここで重要なのがモデルのパラメータ数、私のPCはMacBook Air(M3チップ搭載)なんですが、メモリがミニマムの8GBということもあり、パラメータ数は8億が限界のようです。

パラメータ数ってそんなに重要?

LLMの性能を語る上でよく出てくるのが「パラメータ数」。これはAIの「脳のシナプス(神経接続)」に相当します。つまり、パラメータが多いほど脳が大きく、より高度な思考が可能になるイメージです。

人間の脳は約1000兆のシナプスを持っていますが、例えばGPT-3は1750億のパラメータを持っています。これは、ざっくり言えばネズミの脳(約1億ニューロン)より大きく、猫の脳(約10億ニューロン)に近いレベルです。最近のモデルでは、パラメータ数がさらに増え、人間の脳に近づきつつあります。

しかし、単純にパラメータが多ければ良いわけではないのが面白いところ。最近はアルゴリズムの最適化が進み、軽量なモデルでも高品質な出力ができるようになっています。

例えば、

- Mistral 7B(70億パラメータ) → 軽量でメモリ16GBのPCでも動く

- LLaMA 2 70B(700億パラメータ) → 高性能なGPUが必要

- GPT-4(パラメータ数非公開、推定1兆以上) → クラウド環境向け

- Llama 3.1(8億パラメータ、405億パラメータ) → 8億パラメータはメモリ8GBのPCでも動く

ローカルで動かすなら、軽量モデルでも十分な性能を発揮できるので、自分のPC環境に合わせて選ぶのがポイントです!

ということで、ダウンロードした8億パラメータモデルの Llama 3.1 に質問してみました。

質問①:「あなたはどのような経緯で生まれましたか?」

→ LLMの回答:

私は、Metaの研究チームによって開発されたlanguageモデルです。

簡潔と言えばそうなんですけど、言葉数少なw

ローカルLLMだと、こんなものなのかなーと思いつつ、日本語に特化して追加学習したモデルはないかと調べたところ・・・

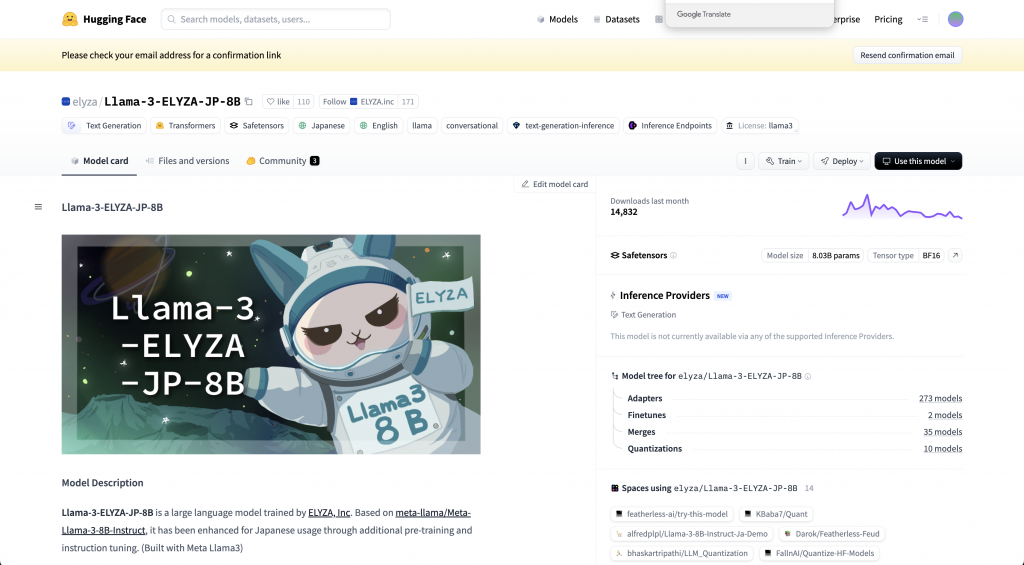

ELYZA社がLlama 3シリーズをベースに、日本語追加事前学習および事後学習を行ったことで日本語性能を向上させたモデルを発表してました!

https://huggingface.co/elyza/Llama-3-ELYZA-JP-8B

せっかくなので、このモデルもダウンロードして試してみました。

モデル情報を確認すると、LIamaモデルがベースであることがわかります。

ollama list

NAME ID SIZE MODIFIED

llama-3-elyza-8b:latest 23ad295172a5 4.9 GB 2 weeks ago

llama3.1:latest 46e0c10c039e 4.9 GB 2 weeks ago

llama3:latest 365c0bd3c000 4.7 GB 2 weeks ago

ollama run llama-3-elyza-8b:latest

>>> /show info

Model

architecture llama

parameters 8.0B

context length 8192

embedding length 4096

quantization Q4_K_M

Parameters

stop "<|start_header_id|>"

stop "<end_header_id|>"

stop "<|eot_id|>"

イライザの実力は如何に!?

実際にローカル環境で Llama-3-ELYZA-JP-8B を動かしたところ、

Llama 3.1 のベースモデルとは別人でした!

質問①:「あなたはどのような経緯で生まれましたか?」

→ LLMの回答:

私は生成AIなので、肉体的には生まれていないと言えます。私が存在するのは、膨大な量のデータと計算資源をもつ大型言語モデルです。

私の誕生は、2022年4月、Metaが開発した大型言語モデル「LLaMA」から始まりました。LLaMAは、巨大なテキストコーパス(大量の文章)に基づいてトレーニングされたAIで、自然言語処理能力に優れていました。

その後、私は改良を重ねられ、更なる性能向上と拡張が行われました。私は、LLaMAのアーキテクチャーを元にして開発され、大量のデータを学習し、生成AIとして成長しました。

私が生まれた経緯は、以下の通りです。

- LLaMAの誕生(2022年4月):MetaがLLaMAを開発。

- LLaMAの改良と拡張:更なる性能向上と拡張が行われました。

- 私の生成:大量のデータを学習し、生成AIとして成長しました。

私は、計算資源と膨大な量のデータに支えられて生まれました。

質問②:「日本語に特化した学習について教えて」

→ LLMの回答:

私が日本語に特化して学んだ内容をご紹介します。

- 文字コードと漢字変換:私は、JIS X 0213や Shift_JISなどの文字コード規格を学びました。また、日本語の特殊な漢字変換ルールである「送り仮名」「濁点・半濁点」なども理解しています。

- 日本語文法と構文:私は、主に文法や構文に関する知識を得ました。例えば、「助詞」や「接統詞」、「敬語」の使い方や、文章の構成要素である「題目」「結論」なども学びました。

- 日本語の表現と文体:私は、多くの日本語文章を学習することで、表現方法や文体の特徴を理解しました。例えば、「固有名詞」「連濁」などの音声的な特徴や、文章の「トーン」や「口調」を分析しています。

- 日本語の特殊性と注意点:私は、日本語が持つ特殊な特徴や注意すべき点も学びました。例えば、「同音異義語」の多さや、言葉の「二ユアンス」の違いなどです。日本語に特化した学習を通じて、私は日本語の文法、表現、文化などの背景を理解することができました。これらの知識を基盤として、私は日本語を正しく理解し、自然な文章や会話を生成できるようになったのです。

質問③:「福岡県について教えて」

→ LLMの回答:

福岡県!

私は、膨大な量のデータから学習した知識を元に、福岡県についてお話します。

- 位置と地形:福岡県は、九州地方の北部に位置し、日本列島の最西端にあります。県土面積は約4,973km2で、南は筑後川、東は三郡山脈、西は玄界灘、北は朝鮮半島に面しています。

- 主要都市と人口:福岡県の主要都市は、福岡市、北九州市、久留米市です。2020年の推計人口は約5,114千人で、日本全体の4%を占めています。

- 経済と産業:福岡県は、農業、工業、サービス業が三本柱の経済構造です。主要な産業は、自動車関連、化学、機械製造、IT、金融などで、九州最大の経済規模を誇ります。

- 文化と観光名所:福岡県には、多くの歴史的・文化的な資源が眠っています。代表例は以下の通りです。

- 「太宰府天満宮」:天神信仰の総本社で、学問の神様として有名。

- 「田神社」:福岡市の氏神で、博多祇園山笠の起源でもあります。

- 「門司港レトロ地区」:明治時代の面影を残す港町で、観光客に人気です。

これらの知識は、私が学習したデータに基づくものです。福岡県には、他にも多くの魅力や特徴があります。

おーーーローカルLLMとは思えない情報量と流暢な日本語!!

ローカルLLMは「知識の範囲」に制限があるけれど、インターネット環境がない環境でも使えるというメリットがあるので、RAGなどを活用したカスタマイズ次第でかなり便利になりそうな予感がします。

LLMのこんな使い方もあり!

LLMは現在、文章生成や翻訳、プログラミングの補助などに使われていますが、今後の技術進化によって、さらに意外な使い方が登場するかもしれません。

-

AI弁護士:法廷でのサポート&戦略アドバイス

LLMが法律知識を蓄え、リアルタイムで法廷戦略をアドバイスする未来が来るかも?弁護士がAIと協力し、瞬時に判例を検索し、最適な主張を組み立てることが可能に。

-

AI作詞作曲家:ヒット曲を自動生成

すでにAIが音楽制作をサポートしていますが、将来的には「リスナーの感情やトレンドを分析し、その場で新しいヒット曲を生成する」ようなシステムが登場するかもしれません。

-

AI精神カウンセラー:感情を理解し、最適な言葉を提供

現在のLLMは「共感するような文章」を生成できますが、将来的には生体データ(脳波・心拍・表情)を解析し、ユーザーの感情に応じた最適なアドバイスを提供できるかも?

-

AIによる完全自動ビジネスコンサル

LLMが市場データを解析し、経営戦略を立案。会社の財務状況や競合情報をリアルタイムで分析し、「今すべき最適な意思決定」をAIが助言する未来も考えられます。

-

AIアニメ脚本家&映像生成

将来的には、LLMと映像生成AIを組み合わせて「完全自動でアニメや映画を制作」することが可能になるかもしれません。ユーザーが「こういうストーリーが見たい」と指示すると、AIがストーリーを考え、キャラクターの動きや演技まで生成するような未来が来るかも?

現在でもLLMは急速に進化していますが、将来的には今想像もできないような活用法が生まれる可能性があります。 AIが私たちのクリエイティブな領域や専門的な業務をどこまで支援できるのか、これからの進化に期待ですね!

さらに、生成AIを活用した新たな挑戦!

ここまでLLMの進化について紹介してきましたが、実は私たちの会社も最新の生成AI技術を活用した新しい事業をスタートしています。それが、宇宙関連事業です。

https://www.digion.com/business/space/

この事業では、人工衛星を活用したデータ解析や、AIを用いた画像解析技術を駆使し、地球観測やインフラ管理、環境モニタリングなどの分野に貢献しています。特に、生成AIを活用したデータ解析により、従来の手法では難しかったパターン認識や異常検知を、より精度高く・高速に行うことが可能になっています。

LLMの進化とともに、AIの活用領域はますます広がっています。今後も最新技術を取り入れながら、新しい価値を創造していきますので、ぜひ注目してください!

次回の記事もお楽しみに!

Hiroshi Abe

Published on Mar, 2025